Geschreven door Frank Bouw naar aanleiding van een stageonderzoek bij Aveco de Bondt.

Het in kaart brengen van groen in de stad is belangrijk voor biodiversiteit, klimaatadaptatie en een gezonde leefomgeving. Groen in kaart brengen is alleen makkelijker gezegd dan gedaan. Dus wat kan de rol van AI zijn om dit proces te versnellen en te automatiseren?

Tijdens mijn onderzoeksstage bij Aveco de Bondt onderzocht ik hoe AI binnen het Tygron-platform hierbij kan helpen. Focus van het onderzoek: het ontwikkelen van een AI-model dat automatisch heggen kan herkennen op luchtfoto’s.

Mijn achtergrond is milieu- en klimaatwetenschappen met een beetje ervaring met GIS. Tijdens mijn stage is gebleken dat het ook zonder een ICT-achtergrond mogelijk is om AI-modellen te maken met behulp van Tygron. In dit onderzoek hebben we ons dus gericht op heggen, maar de werkwijze is op veel meer thema's van toepassing.

Waarom juist heggen in dit onderzoek?

Heggen zijn meer dan alleen erfafscheidingen. Ze vormen belangrijke leefgebieden voor soorten als egels en huismussen en dragen bij aan een groenere uitstraling van de stad. Met betere data van heggen kunnen we dus betere modellen maken over bijvoorbeeld biodiversiteit en hittestress.

Dat is ook iets wat Aveco de Bondt doet met hun biodiversiteitsstresstest: Een GIS-tool waarmee habitatsgeschiktheid in kaart wordt gebracht door verschillende invoerlagen te combineren. Ook voor deze tool geldt dat betere data zorgt voor een preciezere uitkomst van de methodiek. Echter ontbreken heggen vaak nog in bestaande datasets: bomen zijn meestal beter geregistreerd, maar lager groen is minder goed in beeld.

Een AI-model kan daarin verschil maken door dit automatisch te detecteren. Daarnaast kijkt een AI-model op luchtfoto’s ook mee in achtertuinen, zo komt naast het openbaar groen ook het privaatgroen in beeld.

Zelf een AI-model trainen met Tygron

Tygron heeft recent een AI-functionaliteit toegevoegd waarmee gebruikers zelf objectherkenningsmodellen kunnen ontwikkelen. Voor mijn onderzoek heb ik dit proces in vijf stappen doorlopen:

- Trainingsdata maken

In QGIS heb ik vijf trainingsgebieden in Ede geselecteerd en daarin ruim 1900 heggen met de hand ingetekend.

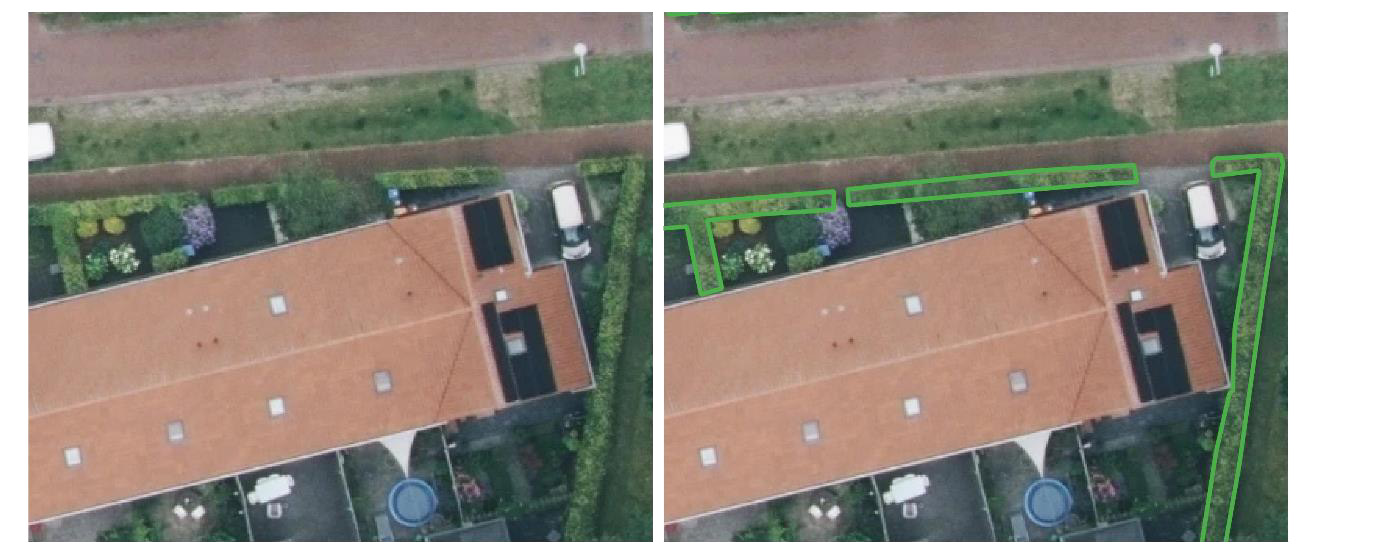

Visualisatie van intekenen heggen. Links een afbeelding waar de heggen nog niet zijn ingetekend en rechts een afbeelding waar de heggen zijn ingetekend. - Data klaarmaken in Tygron

De luchtfoto’s en ingetekende heggen zijn vervolgens ingeladen in Tygron en geëxporteerd als trainings- en testdata die de input vormen voor het trainen van het AI model. - Het model trainen

Met behulp van de open-source repository van Tygron heb ik een Mask R-CNN model getraind. Dit type AI is in staat om objecten niet alleen te herkennen, maar ook precies te omlijnen. Tijdens de training is geëxperimenteerd met verschillende instellingen en aantallen iteraties (epochs). Voor het aantal epochs/iteraties geldt dat er een bepaald optimum is: bij te veel epochs wordt het model te streng en bij te weinig blijft het model te soepel. - Het model testen

Na de training kon het model toegepast worden op luchtfoto’s van Ede. De resultaten zijn eerst getest door te vergelijken met de ingetekende heggen voor de trainingsdata. Om de model prestatie te beoordelen, heb ik gebruikgemaakt van twee maten: precisie en volledigheid. De precisie geeft aan hoeveel van de door het model gevonden heggen ook écht heggen zijn, terwijl de volledigheid (recall) laat zien hoeveel van de aanwezige heggen door het model herkend werden. Een heel streng model kan bijvoorbeeld een hoge precisie hebben, maar wel veel heggen missen, wat ook niet wenselijk is. Dit wordt inzichtelijk door ook naar de volledigheid te kijken. - Het model valideren

Na het testen is het model ook gevalideerd aan de hand van data uit veldwerk in twee verschillende wijken: Een wijk met veel en een wijk met weinig bomen. Hieruit bleek dat veel heggen al niet zichtbaar zijn op de luchtfoto vanwege een aantal limitaties van de luchtfoto’s:- Hellend effect: Doordat de luchtfoto in een hoek is genomen zijn heggen dichtbij hoge gebouwen niet zichtbaar.

- Schaduw effect: Als de luchtfoto op een zonnige dag is genomen zijn sommige delen slecht zichtbaar door schaduw van hoge gebouwen of bomen.

- Overhangend effect: heggen onder overhangende objecten, zoals bomen, zijn niet zichtbaar.

Met name deze limitatie bleek ervoor te zorgen dat 50% van de heggen niet zichtbaar is in een wijk met veel bomen.

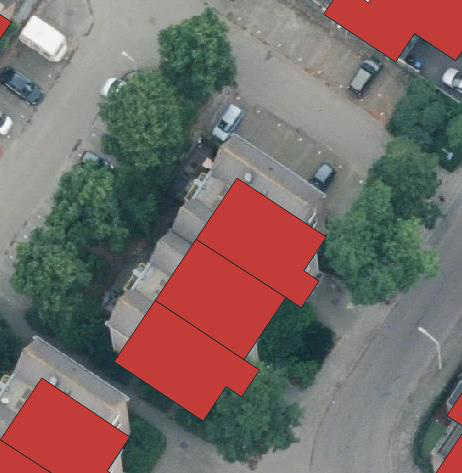

Visualisatie van het hellende effect, het schaduw effect en het effect van overhangende bomen op de luchtfoto van 2024 (links, bewolkt) en 2023 (rechts, zonnig). De rode vlakken geven de BAG registratie van panden aan, wat de locatie van het pand op het maaiveld aangeeft. Daardoor is duidelijk zichtbaar dat een deel van de omgeving van het pand wegvalt door de hoek waarin de luchtfoto is genomen. Ook is er veel niet zichtbaar door de overhangende bomen en geeft de luchtfoto rechts ook een duideli jk beeld van het schaduw effect.

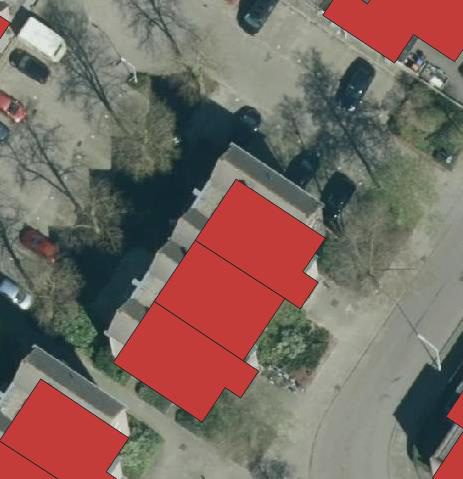

Visualisatie van de model output t.o.v. de heggen die in kaart gebracht zijn tijdens het veldwerk.

De blauwe vlakken zijn de model output en de groene omlijningen de ingetekende heggen.

Resultaten

In een wijk met weinig bomen waren de precisie en volledigheid ongeveer 50% en in een wijk

met veel bomen ongeveer 25%. Dit is niet genoeg voor het precies in kaart brengen van

heggen.

Het getrainde Neurale Netwerk in deze studie is dus nog niet voldoende om echt

bruikbaar te zijn in de onderzoeken van Aveco de Bondt.

Belangrijk resultaat is wel dat het is gelukt om zonder ICT-achtergrond een eigen AI model te maken en toe te passen. De optie om zelf AI-modellen te maken op satellietbeelden of luchtfoto's biedt dus de mogelijkheid om meer data te gaan verzamelen en bestaande bronnen te verrijken.

Lessons Learned

Wat dit onderzoek allereest laat zien is dat het mogelijk is om een eigen AI model te maken en toe te passen in Tygron voor mensen zonder een ICT-achtergrond. Daarnaast is een belangrijke les dat er goed gekeken moet worden naar de brondata en het doel. In dit geval bleek achteraf dat veel heggen überhaupt ‘onzichtbaar’ zijn op een luchtfoto.

Bedenk dus goed van tevoren of het doel behaald kan worden met de luchtfoto's en/of satellietdata die voorhanden is.

Op het gebied van het in kaart brengen van duidelijkere objecten, zoals zonnepanelen, zijn er voorbeelden van betere resultaten. Daarnaast heeft Tygron zelf een Foliage AI model die al best goed werkt.

Wat is de AI Suite van Tygron?

De AI Suite van Tygron is een verzameling krachtige tools waarmee bijvoorbeeld stedenbouwkundigen en GIS-specialisten eigen neurale netwerken kunnen trainen en direct inzetten op het Tygron Platform.

De suite maakt het mogelijk om bijvoorbeeld bomen, struiken of andere objecten automatisch te herkennen in satellietbeelden en andere kaarten met behulp van machine learning. Dit gebeurt razendsnel via GPU-supercomputers die direct gekoppeld zijn aan het platform.

Intentie en waarde

Het doel van de AI Suite is om geavanceerde AI-technologie bereikbaar te maken voor gebruikers zonder diepgaande programmeerkennis. Tygron zet sterk in op open source en toegankelijkheid: gebruikers kunnen bestaande open modellen gebruiken, maar ook hun eigen neurale netwerken uploaden en toepassen in projecten. Dankzij de ondersteuning van open standaarden zoals ONNX is het eenvoudig om getrainde modellen uit bijvoorbeeld PyTorch direct te integreren.Zelf aan de slag: handige linkjes

- Introductie en uitleg: https://www.tygron.com/nl/ai/

- Stapsgewijze handleiding en scripts: https://previewsupport.tygron.com/wiki/How_to_train_your_own_AI_model_for_an_Inference_Overlay

- Open source repository & scripts: https://github.com/Tygron/tygron-ai-suite

- Technische sessie over AI Inference Overlay (PDF) Technische sessie over AI Inference Overlay:

Met deze resources kun je eenvoudig starten met het herkennen van groen data uit beelden op het Tygron platform, of zelfs eigen AI-modellen trainen en toepassen.